Esta mañana le he contestado a alguien en LinkedIn que decía haberse ahorrado 3.000 euros haciendo la declaración de la renta con ChatGPT. Los comentarios eran un festival de aplausos. Yo le he contestado porque a mí me pasó exactamente lo mismo. Solo que yo tuve la precaución de comprobarlo.

Le pasé mis datos a Claude —uno de los modelos de Anthropic— y me devolvió una declaración que me daba unos 3.000 euros de devolución. Los números cuadraban. Las casillas estaban bien puestas. El formato era impecable. Si no trabajo con IA todos los días, la presento sin pestañear.

Pero la pasé por Codex —que usa GPT— para que le diera un segundo vistazo. Y la fiesta se acabó.

Deducciones que no correspondían. Ingresos mal categorizados. Un cálculo de retenciones que partía de una premisa equivocada. No era un desastre obvio: eran quince decisiones intermedias, cada una aparentemente razonable, que juntas convertían el resultado en ficción.

Tres mil euros. Que no eran tres mil euros.

El modelo no había fallado de la forma en que estamos acostumbrados a que fallen las cosas. No dio un error. No se bloqueó. No dijo «no sé hacer esto». Hizo algo mucho peor: me entregó un resultado equivocado con la misma confianza con la que entrega uno correcto.

El tipo de error que no existía antes de la IA

Llevamos décadas lidiando con tecnología que falla. Y hemos desarrollado instintos para detectarlo: pantallazos azules, mensajes de error, formularios que no se envían, la página que da 404. Cuando algo va mal, algo te lo dice.

Con la inteligencia artificial eso ya no funciona.

Cuando una IA se equivoca, no cambia de tono. No pone un asterisco. No baja el volumen. Te entrega el resultado con el mismo aplomo que cuando acierta. Y tú, que llevas toda la vida asociando «presentación profesional» con «contenido fiable», le das al botón de enviar.

Yo lo llamo éxito falso silencioso: un resultado que pasa todos tus filtros de «¿esto tiene buena pinta?» porque tiene muy buena pinta. Solo que está mal.

Y no es un caso raro. Es el modo de fallo por defecto de cualquier modelo de lenguaje. Están diseñados para generar lo que suena más probable, no lo que es más correcto. La mayoría de las veces coinciden. Cuando no coinciden, no hay absolutamente nada que te lo señale.

Lo veo cada semana en mi trabajo

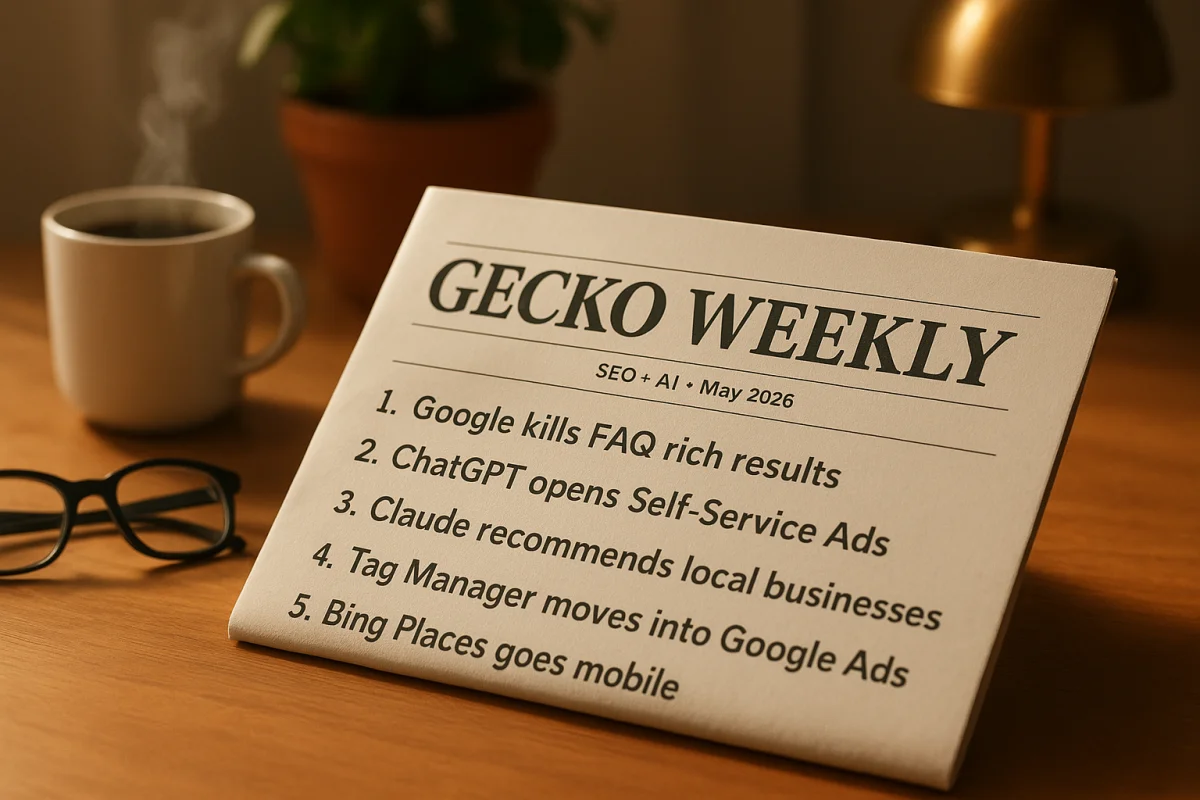

Dirijo una agencia de marketing digital. Usamos IA para cosas que van desde analizar posicionamiento web hasta redactar borradores de propuestas. Es una herramienta brutal. Y los éxitos falsos nos los encontramos constantemente.

Un ejemplo que me jode especialmente: le pides a la IA que optimice los meta tags de la web de un cliente. Te devuelve títulos y descripciones que suenan profesionales, con la longitud correcta, con llamadas a la acción incluidas. Perfecto. Hasta que miras con lupa y resulta que tres páginas compiten ahora por la misma palabra clave, dos apuntan a una intención de búsqueda que no es la suya, y una incluye una promesa que el cliente no puede cumplir. Has «optimizado» la web y la has dejado peor. Sin que nada te avisara.

Otro: un borrador de email a un cliente insatisfecho. Tono perfecto, empático, resolutivo. Solo que la IA ha ofrecido un descuento que nadie autorizó y ha reconocido implícitamente una responsabilidad que la empresa no tenía. Si lo envías tal cual, le estás regalando un argumento legal a quien te quiera reclamar.

O el clásico: un artículo para el blog que suena a experto y cita un dato normativo que no existe, o que existía pero fue modificado hace dos años. Lo publicas, y tres semanas después descubres que tu «contenido de autoridad» tiene información falsa que Google no perdona y que tus lectores tampoco deberían.

Ninguno de estos fallos se ve a primera vista. Todos parecen trabajo bien hecho. Y todos habrían pasado el filtro de «¿tiene buena pinta?» sin problema.

Cuanto mejor suena, menos lo miras

Esto es lo que convierte un fallo técnico en un problema de verdad.

Cuando un becario te entrega un informe con erratas y el formato descuadrado, lo revisas entero. Tu cerebro se pone en modo alerta. Pero cuando te llega un documento impecable, bien maquetado, bien escrito, lo lees en diagonal. Asumes que si la forma es buena, el fondo también.

Con la IA este atajo mental te la juega cada vez. Porque la forma siempre es buena. La IA nunca te entrega un borrador feo. Nunca mete una errata. Nunca deja un hueco donde debería ir un dato. Todo está rellenado, todo suena fluido, todo tiene aspecto de producto terminado.

Y encima hay una presión de tiempo que juega en contra: si la IA ha tardado 30 segundos en generar algo, tu cerebro no quiere dedicar 30 minutos a comprobarlo. Parece desproporcionado. Pero es que esos 30 segundos no han incluido ninguno de los filtros que un profesional aplica mientras trabaja: dudar, consultar, revisar, corregir sobre la marcha. La IA te da el resultado final sin el proceso. Y el proceso es donde se pillan los errores.

Qué hacemos nosotros para no caer

No voy a darte una lista de diez mandamientos. Voy a contarte las tres cosas que realmente nos funcionan en el día a día.

La primera es la más obvia y la que mejor funciona: pasarlo por otro modelo. Si lo generó Claude, lo revisa GPT. Si lo generó GPT, lo revisa Claude o Gemini. Cada modelo tiene sesgos diferentes, y lo que uno da por bueno, el otro lo cuestiona. Es exactamente lo que nos salvó con la declaración de la renta. No es infalible, pero eleva el listón enormemente.

La segunda: preguntarle a la IA qué ha asumido. Un simple «¿qué supuestos has utilizado para esto?» después de recibir el resultado. Los errores gordos casi nunca están en los datos visibles; están en las premisas invisibles. El modelo asumió que tributas por módulos cuando tributas por estimación directa, o que tu empresa está en el régimen general cuando está en el simplificado. Saca las premisas a la luz y la mitad de los falsos positivos se caen solos.

La tercera: coger el dato que más pesa y comprobarlo a mano. No todo. Uno. La cifra más importante, la afirmación más fuerte, el dato que más condiciona la conclusión. Si ese resiste, el resto tiene cierta credibilidad. Si ese cae, tíralo todo a la basura.

¿Son tres pasos que cuestan cinco minutos en total? Sí. ¿Nos han evitado publicar artículos con datos falsos, enviar emails comprometedores y presentar una declaración de la renta incorrecta? También.

La IA no sustituye la verificación, la hace más necesaria que nunca

No tengo ningún problema con la inteligencia artificial. La uso más horas al día de las que quiero admitir. Me hace más productivo de lo que era hace dos años, y eso es un hecho.

Pero la productividad sin verificación es velocidad sin dirección. Llegas antes, pero no sabes adónde.

El de LinkedIn que celebra sus 3.000 euros puede tener razón. O puede que reciba una paralela de Hacienda en septiembre que le cueste bastante más de 3.000. La diferencia entre un escenario y otro no es la IA que usó. Es si alguien —un segundo modelo, un asesor, él mismo con una calculadora— comprobó el resultado antes de darle a enviar.

Si trabajas con inteligencia artificial, trabaja también con un filtro. No hace falta que sea caro, ni lento, ni sofisticado. Hace falta que exista.

Porque el mayor problema de la IA no es cuando se equivoca y lo ves. Es cuando se equivoca y no lo ves. Y por la experiencia de alguien que lo vive cada día: pasa más de lo que crees.